70 € y una cámara que piensa sola: la Raspberry Pi AI Camera no necesita GPU para ver

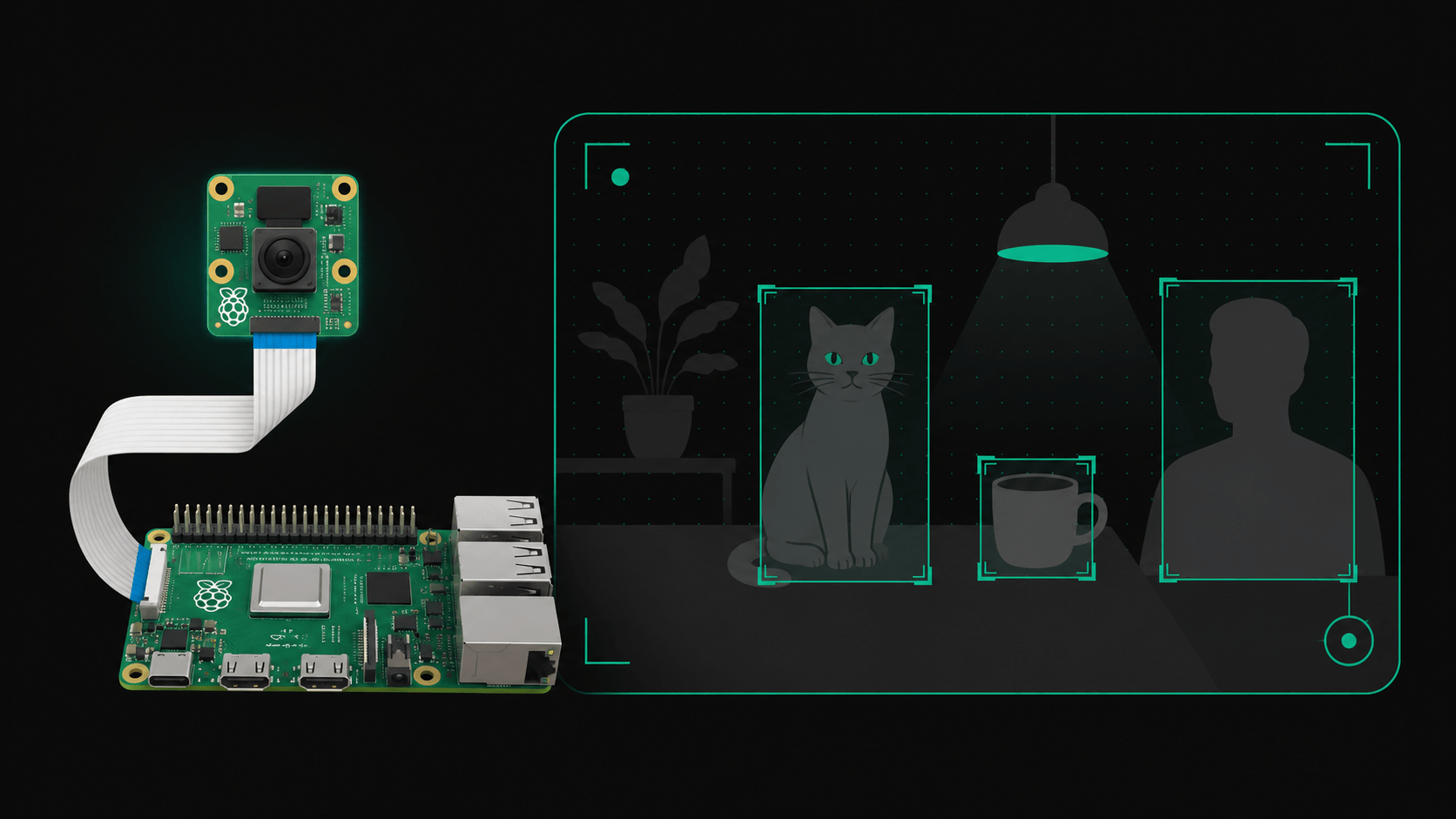

La Raspberry Pi AI Camera lleva un sensor Sony IMX500 con NPU integrada. Detecta objetos, personas y poses sin tocar la CPU de tu Pi.

💡 Antes de empezar Necesitas: Una Raspberry Pi AI Camera (~70 €), una Raspberry Pi (cualquiera: desde la Zero W hasta la Pi 5), un cable CSI compatible y una tarjeta SD con Raspberry Pi OS actualizado. Tiempo estimado: Entre 30 minutos y una hora para tener detección de objetos funcionando. Nivel: Necesitas perder el miedo a la terminal — hay comandos que copiar y pegar, pero nada que no esté documentado paso a paso.

La cámara más interesante que Raspberry Pi ha sacado nunca

Cada pocos meses sale una cámara nueva para Raspberry Pi. Más megapíxeles, mejor lente, autoenfoque. Mejoras incrementales. La AI Camera es diferente: no es solo una cámara — es una cámara con cerebro propio.

Dentro del sensor Sony IMX500 hay un acelerador de redes neuronales — una NPU, que es un procesador especializado en ejecutar modelos de inteligencia artificial — que puede correr modelos de detección de objetos, segmentación de imagen, estimación de poses y clasificación directamente en el sensor, a 30 fotogramas por segundo, sin usar ni un ciclo de la CPU de tu Raspberry Pi.

Esto cambia las reglas del juego porque hasta ahora, correr visión por computador en una Raspberry Pi significaba elegir entre resolución y velocidad: modelos grandes con buena detección pero a 2-3 FPS, o modelos diminutos y rápidos pero que confundían un gato con un zapato. La AI Camera elimina ese compromiso.

Qué hay dentro del IMX500

El sensor tiene dos partes que trabajan juntas:

El sensor de imagen — 12,3 megapíxeles, igual que el de la Camera Module 3 HQ. Captura en 4056×3040 a 10 FPS o en modo 2×2 binned (2028×1520) a 30 FPS. Enfoque manual con ajuste mecánico, campo de visión de 78,3° y apertura f/1.79 — muy luminosa para interiores.

El acelerador neural — aquí está la magia. Es un procesador dedicado con 8 MB de memoria propios que ejecuta modelos de redes neuronales directamente sobre los píxeles del sensor, antes de que la imagen llegue a la Raspberry Pi. La Pi solo recibe los metadatos — “hay una persona en la posición X,Y con un 94% de confianza” — en lugar de tener que procesar cada frame completo.

El resultado es que la CPU de tu Pi queda libre para hacer otras cosas: correr un servidor web, ejecutar Home Assistant, procesar la lógica de automatización. La cámara piensa sola.

Qué puedes hacer con ella (hoy, sin inventar nada)

Detección de objetos en tiempo real: Modelos como MobileNet SSD y EfficientDet vienen preconfigurados. Enchufas, ejecutas un script de ejemplo y tienes bounding boxes — rectángulos que enmarcan los objetos detectados — alrededor de personas, coches, animales, botellas, sillas y otros 76 objetos del dataset COCO.

Estimación de poses: El modelo PoseNet corre en el sensor y devuelve las coordenadas de 17 puntos del cuerpo humano — cabeza, hombros, codos, muñecas, caderas, rodillas, tobillos. Útil para interfaces gestuales, detección de caídas en personas mayores, o análisis de ejercicios físicos.

Segmentación semántica: En lugar de solo detectar “hay una persona aquí”, el sensor puede clasificar cada píxel de la imagen: esto es persona, esto es fondo, esto es coche. Ideal para aplicaciones que necesitan recortar el fondo o aislar objetos.

Clasificación de imagen: Modelos como EfficientNet clasifican la escena completa: “esto es una cocina”, “esto es un parque”, “esto es un garaje”. Más simple pero útil para disparar automatizaciones basadas en contexto visual.

Cómo empezar

Paso 1: Actualiza tu Raspberry Pi OS a la última versión. El soporte para IMX500 necesita los paquetes más recientes:

sudo apt update && sudo apt full-upgrade

sudo apt install imx500-all

Paso 2: Conecta la AI Camera al puerto CSI de tu Pi con el cable plano. Cuidado: la Pi 5 usa un conector CSI más pequeño que la Pi 4 — asegúrate de tener el cable correcto.

Paso 3: Reinicia y comprueba que la cámara está detectada:

rpicam-hello -t 5s

Paso 4: Lanza la detección de objetos con el modelo preinstalado:

rpicam-hello -t 0 --post-process-file /usr/share/rpi-camera-assets/imx500_mobilenet_ssd.json --lores-width 640 --lores-height 480

Verás una ventana con la imagen de la cámara y rectángulos de colores marcando cada objeto detectado con su etiqueta y porcentaje de confianza. Todo esto corriendo en el sensor — mira el uso de CPU con htop y verás que apenas se inmuta.

Lo que no te van a contar

Los 8 MB de memoria del acelerador neural limitan el tamaño de los modelos que puedes cargar. YOLO en sus versiones más grandes no cabe — necesitas usar las versiones nano o tiny, que son menos precisas. Para la mayoría de aplicaciones domésticas (vigilancia, automatización, proyectos de hobby) sobra, pero si necesitas detección de precisión industrial, esto no es tu herramienta.

El ecosistema de modelos compatibles está creciendo pero todavía es joven. Puedes convertir tus propios modelos con el toolkit de Sony, pero el proceso de conversión tiene sus trampas y no todos los modelos se portan bien al formato IMX500. La documentación oficial ha mejorado mucho, pero sigue habiendo lagunas si sales del camino feliz.

Y el enfoque manual es un arma de doble filo: no hay autoenfoque, así que si cambias la distancia al sujeto, tienes que girar la lente físicamente. Para una cámara fija de vigilancia es irrelevante; para un robot móvil, puede ser un problema.

Veredicto

Por 70 € la Raspberry Pi AI Camera democratiza la visión por computador de una manera que no existía hace un año. Antes necesitabas una Coral TPU (descatalogada y a precios inflados) o una Jetson Nano para hacer inferencia en tiempo real. Ahora lo haces con una cámara que se enchufa al mismo puerto CSI de siempre y no le pide nada extra a tu Pi. Si estás buscando un proyecto de computer vision que funcione de verdad sin gastarte 300 € en hardware, empieza aquí.