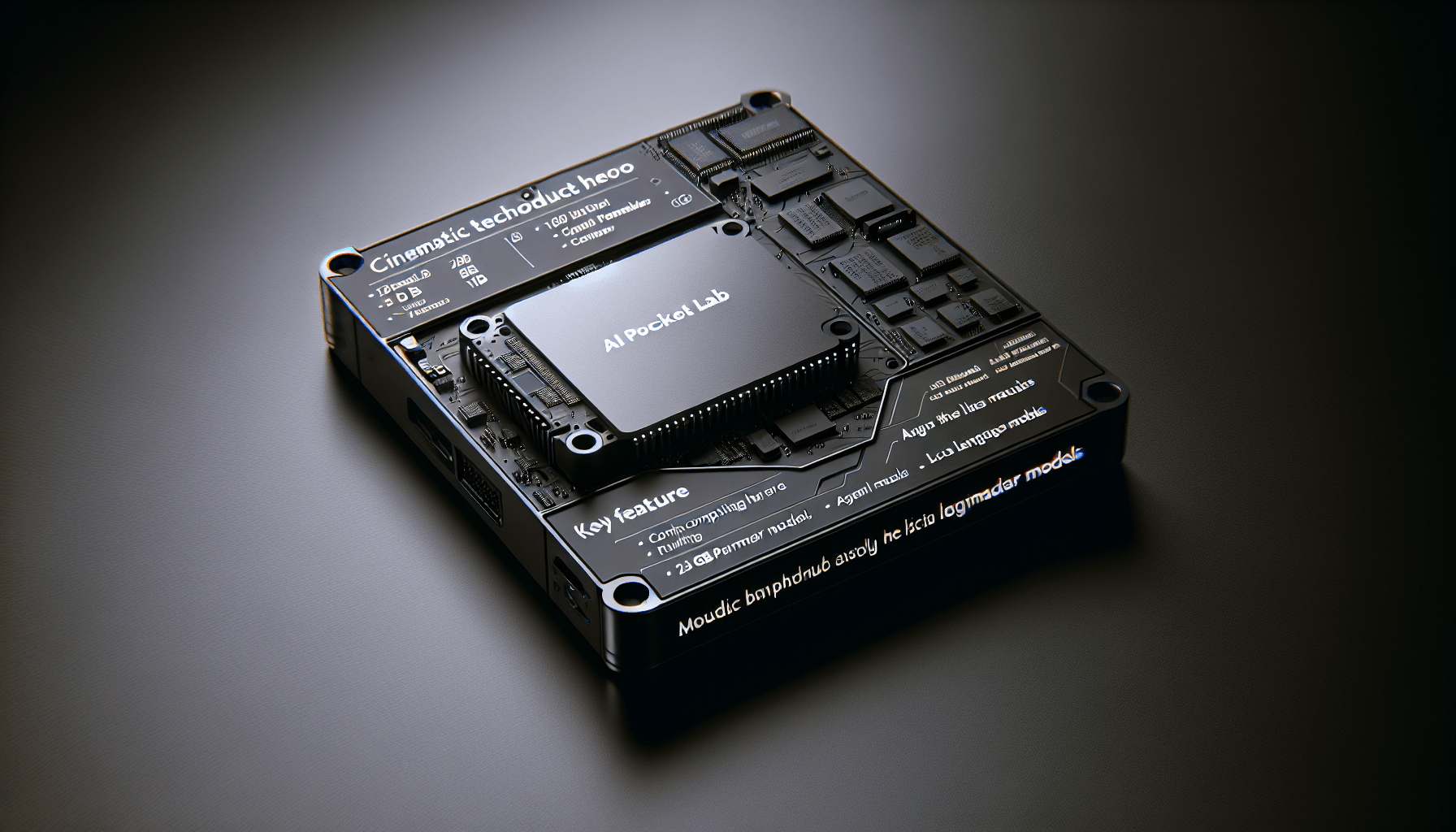

Un cacharro de bolsillo con 80 GB de RAM que corre IA de 120B parámetros sin internet — ¿demasiado bueno para ser verdad?

Tiiny AI Pocket Lab: 80 GB de memoria, modelos de 120B offline y récord Guinness. Analizamos qué promete, qué sabemos y qué no cuadra del todo.