195 € y una Raspberry Pi: esta tarjeta china de IA le da una paliza al HAT oficial

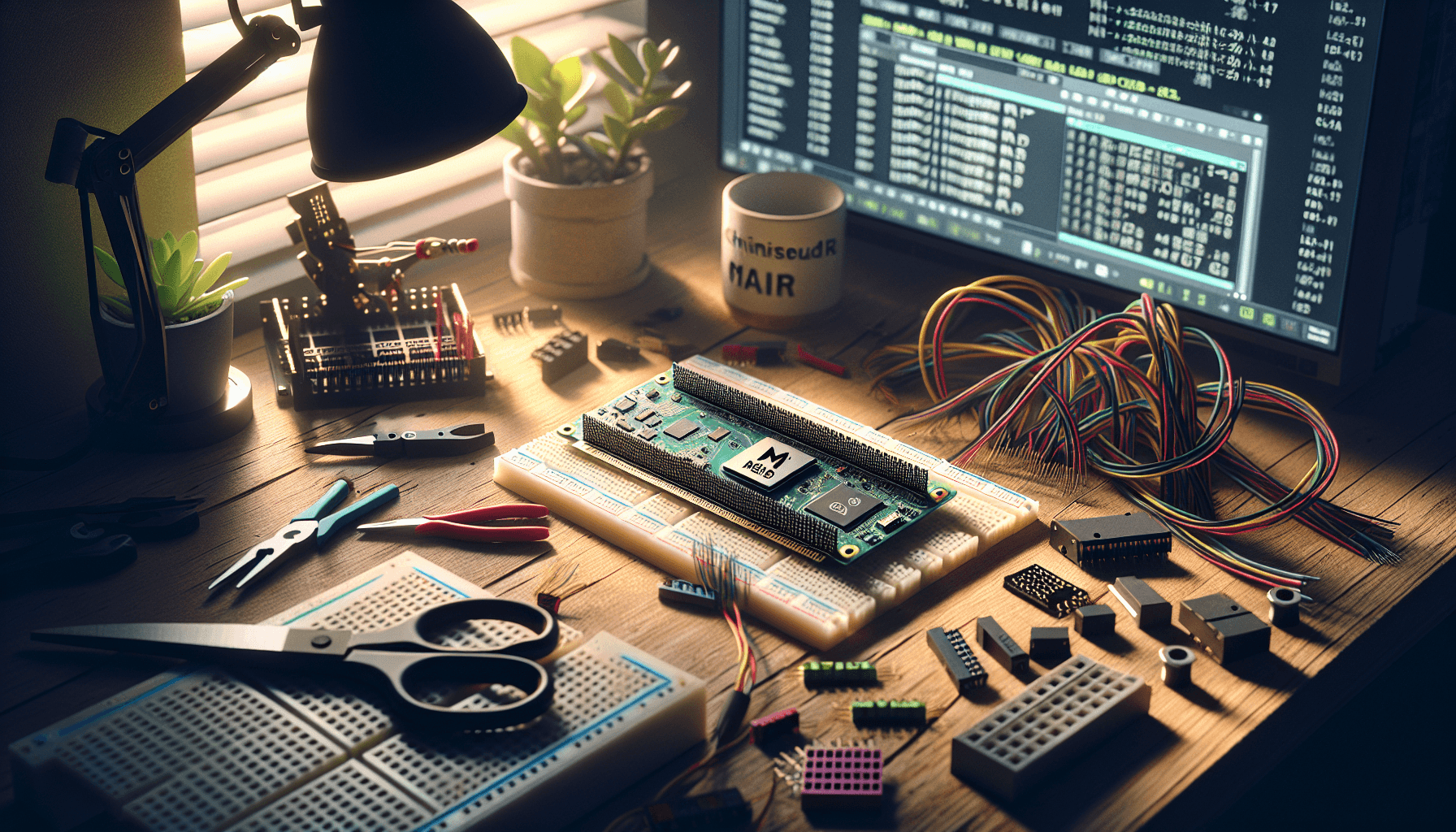

El M5Stack LLM-8850 es una tarjeta M.2 con 24 TOPS y 8 GB de RAM que convierte tu Raspberry Pi 5 en una estación de IA local. Análisis, setup y veredicto.

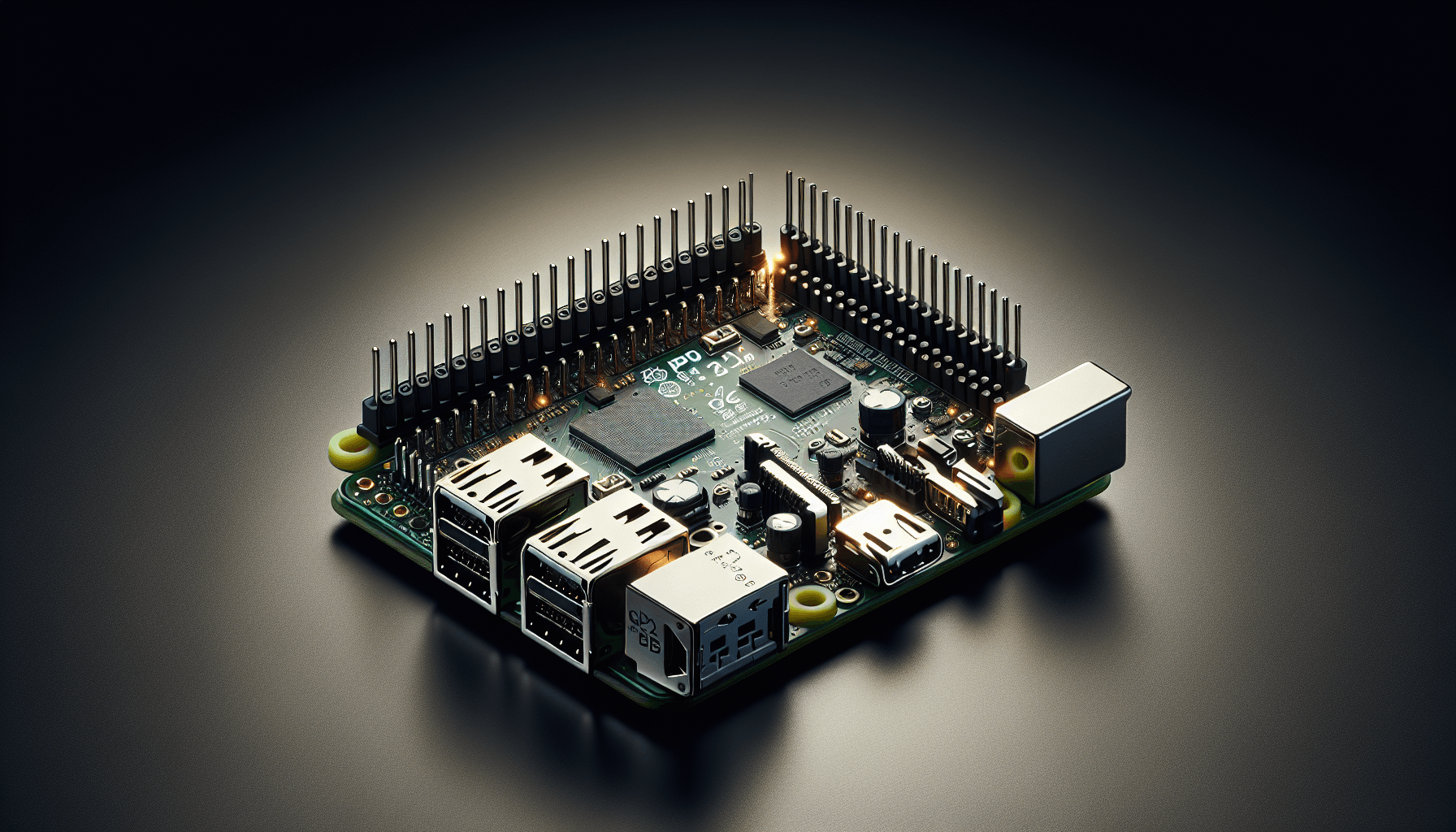

Raspberry Pi, ESP32 y otras single-board computers

Las single-board computers son el punto de entrada más popular para IA local — y con razón. Consumen entre 5 y 25W, caben en cualquier sitio, y con los aceleradores correctos pueden correr modelos de voz, visión y lenguaje que hace dos años requerían hardware de escritorio. La Raspberry Pi 5 sigue siendo la referencia, pero el ecosistema de alternativas ha crecido mucho.

El M5Stack LLM-8850 es una tarjeta M.2 con 24 TOPS y 8 GB de RAM que convierte tu Raspberry Pi 5 en una estación de IA local. Análisis, setup y veredicto.

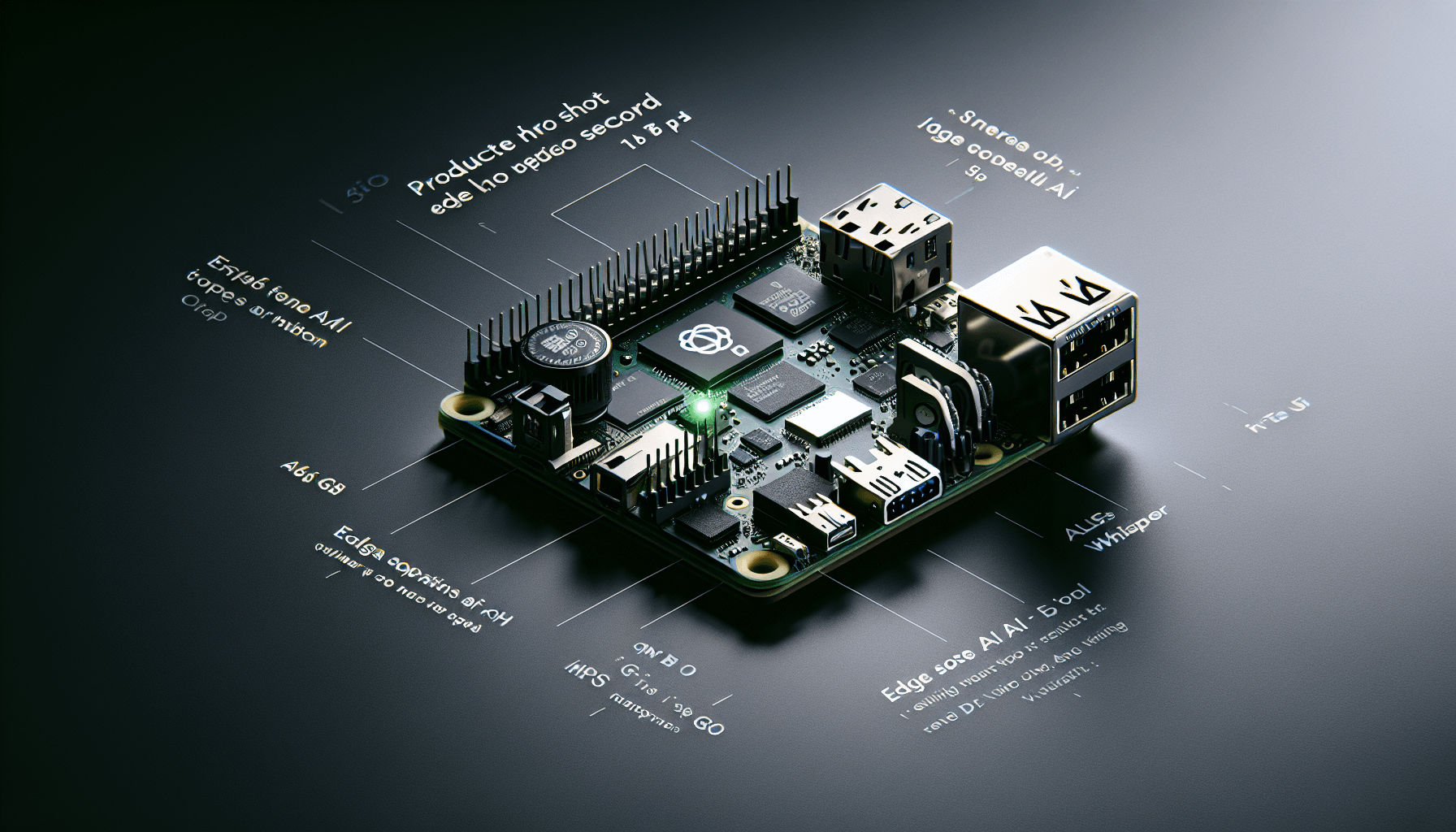

La Arduino Ventuno Q lleva un chip Qualcomm con NPU de 40 TOPS, 16 GB de RAM y corre LLMs, Whisper y visión offline. Te contamos cómo empezar.

La Raspberry Pi AI HAT+ 2 trae un chip Hailo-10H de 40 TOPS y 8 GB de RAM dedicada para correr LLMs en local. Te contamos cómo montarlo desde cero.

El Raspberry Pi AI HAT+ 2 con Hailo-10H convierte tu Pi 5 en un asistente de voz con IA local. Whisper, Ollama y Piper sin depender de internet.

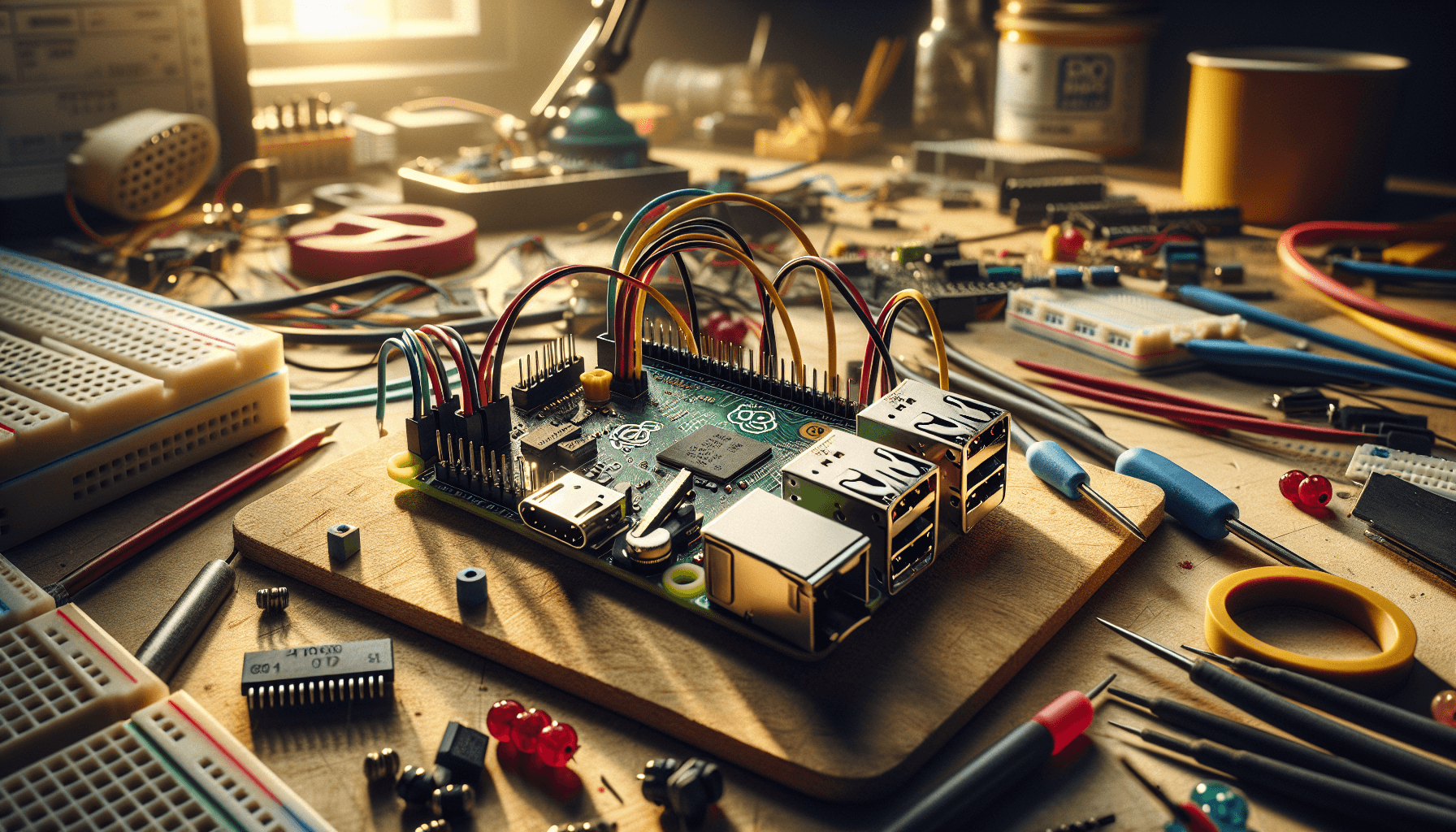

Para modelos de lenguaje pequeños (1-3B parámetros), cualquier SBC con 8 GB de RAM funciona en CPU. El salto real viene con los HATs de IA o aceleradores externos: 13-40 TOPS cambian completamente la experiencia en inferencia de voz e imagen. Si el proyecto necesita siempre estar encendido y responder en tiempo real, prioriza el consumo en idle sobre el pico de rendimiento.

Sí. La Raspberry Pi 5 con 8 GB puede correr modelos de 1-3B parámetros directamente en CPU a unos 3-5 tokens por segundo — lento para conversación, pero útil para automatizaciones. Con un AI HAT+ (13-40 TOPS) la velocidad de inferencia mejora significativamente para voz e imagen.

La velocidad de inferencia. Con 13 TOPS puedes correr Whisper y modelos de visión livianos en tiempo real. Con 40 TOPS tienes margen para modelos más grandes y pipelines que combinan voz + visión + LLM sin cuellos de botella.

Es la combinación más popular y probada. Una Pi 5 con 8 GB maneja Home Assistant, Whisper local y un LLM pequeño simultáneamente con consumo inferior a 15W. El límite llega si quieres correr modelos grandes o procesamiento de vídeo en tiempo real.