65 € y un cable: cómo convertir un mini PC en un servidor de IA que enciendes solo cuando lo necesitas

El dock eGPU Minisforum DEG2 conecta una gráfica potente a tu mini PC por OCuLink. Monta un servidor LLM local por menos de 600 €.

8 contenidos con esta etiqueta.

El dock eGPU Minisforum DEG2 conecta una gráfica potente a tu mini PC por OCuLink. Monta un servidor LLM local por menos de 600 €.

Tiiny AI Pocket Lab: 80 GB de memoria, modelos de 120B offline y récord Guinness. Analizamos qué promete, qué sabemos y qué no cuadra del todo.

El M5Stack LLM-8850 es una tarjeta M.2 con 24 TOPS y 8 GB de RAM que convierte tu Raspberry Pi 5 en una estación de IA local. Análisis, setup y veredicto.

La Raspberry Pi AI HAT+ 2 trae un chip Hailo-10H de 40 TOPS y 8 GB de RAM dedicada para correr LLMs en local. Te contamos cómo montarlo desde cero.

El GMKtec EVO-X2 con Ryzen AI Max+ 395 asigna hasta 96 GB de VRAM y corre Llama 3.1 70B en local. El Mac Studio de quien no quiere Apple.

La RTX 3090 usada ofrece 24 GB de VRAM por ~650 €, ideal para correr modelos de IA de hasta 32B parámetros en casa. Te contamos cómo montarla.

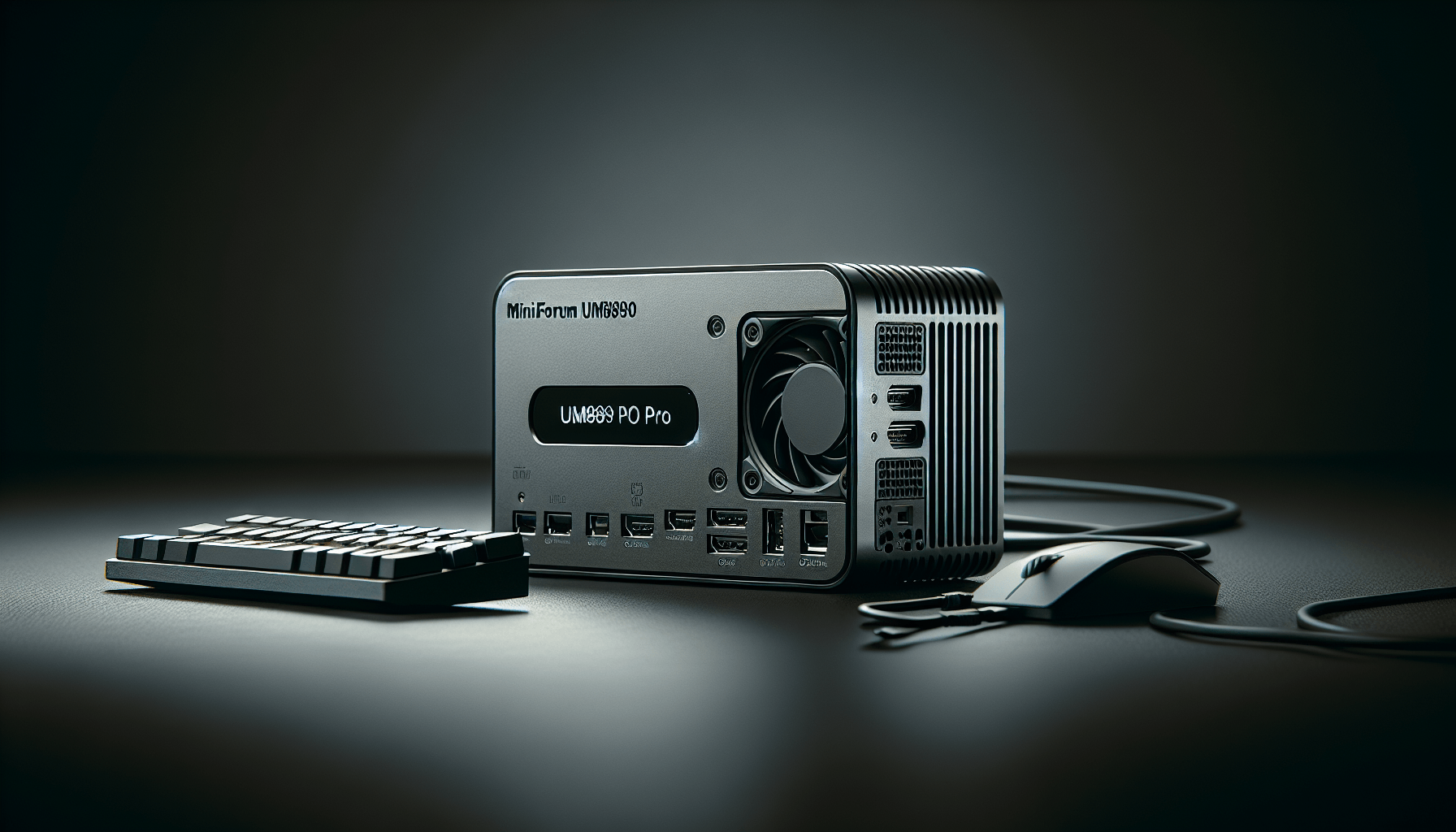

Minisforum UM890 Pro con OCuLink: arranca modelos de IA con la gráfica integrada y escala a 70B parámetros enchufando una GPU externa. Guía para montarlo.

La APU AMD BC-250, reciclada de PS5 defectuosas, corre modelos de IA de 14B parámetros con Ollama y Vulkan por una fracción del precio. Te contamos cómo.