El mini PC de 530€ que empieza corriendo IA y termina siendo una bestia con GPU externa

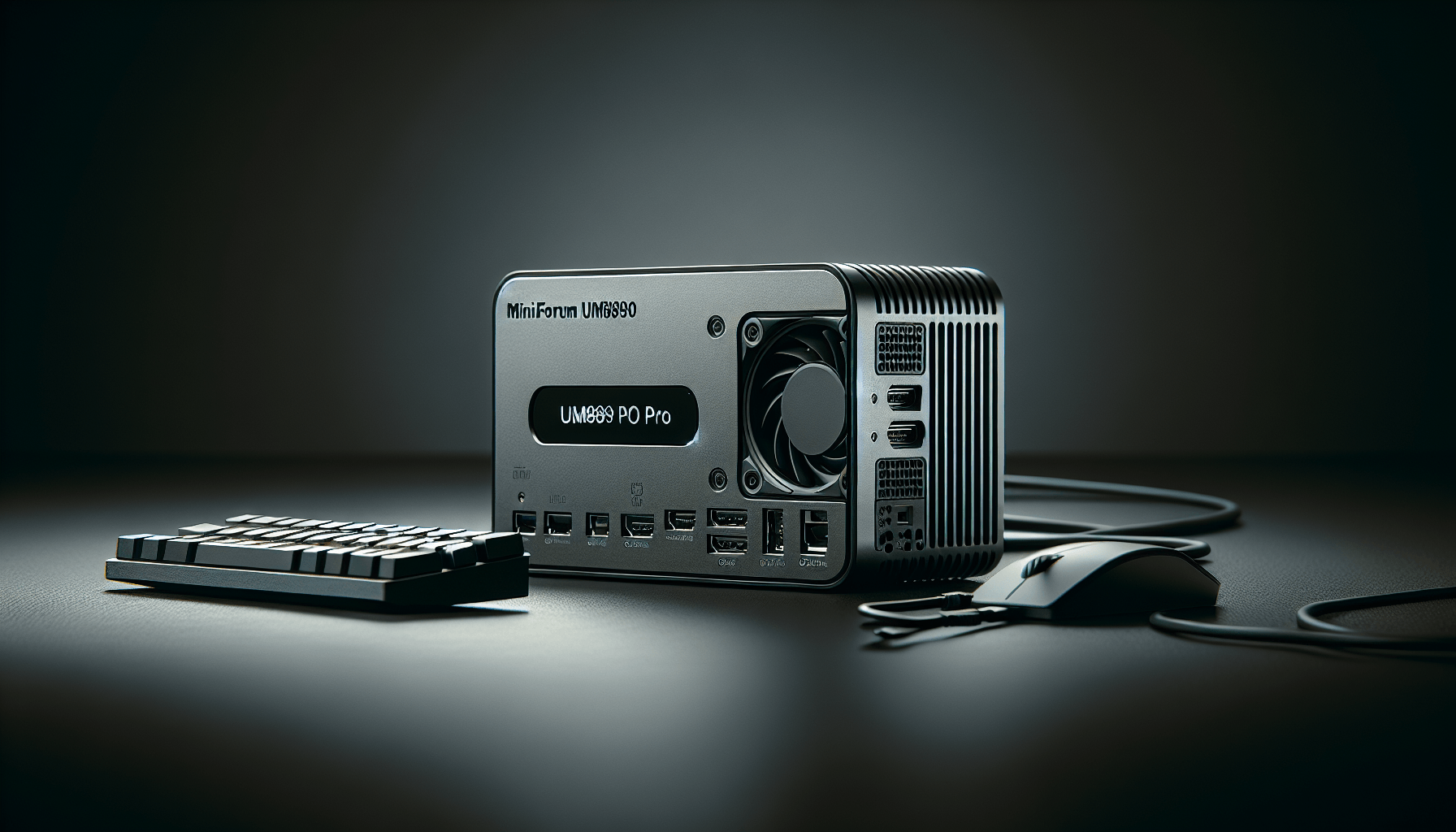

Minisforum UM890 Pro con OCuLink: arranca modelos de IA con la gráfica integrada y escala a 70B parámetros enchufando una GPU externa. Guía para montarlo.

💡 Antes de empezar Necesitas: El UM890 Pro (~530 €), RAM DDR5 y un SSD NVMe si compras el barebone. Para escalar: dock DEG1 (~109 €) + una GPU dedicada. Tiempo estimado: Una tarde para tenerlo corriendo modelos de IA. Un rato más si le conectas la GPU externa. Nivel: Necesitas perder el miedo a la terminal — hay guías paso a paso para todo.

Un PC del tamaño de un libro que escala como un sobremesa

La pregunta más repetida en r/LocalLLaMA — la comunidad de Reddit donde miles de personas corren inteligencia artificial en sus propios ordenadores — es siempre la misma: “¿Qué compro para empezar sin gastarme 2.000 €?”. La respuesta que más se repite últimamente cabe en la palma de tu mano. Es un miniPC de Minisforum con un puerto escondido en la parte trasera que cambia las reglas del juego.

Qué es exactamente el UM890 Pro

Es un ordenador completo metido en una caja de 12,7 × 12,7 cm. Dentro lleva un AMD Ryzen 9 8945HS — un procesador de 8 núcleos con una gráfica integrada Radeon 780M que, sorpresa, puede correr modelos de IA — y acepta hasta 64 GB de RAM DDR5. Consume unos 15W cuando está encendido sin hacer nada, lo que lo convierte en candidato perfecto para dejarlo funcionando 24/7 como servidor.

Pero lo realmente interesante es un conector que Minisforum puso en la parte trasera: OCuLink. Es una conexión física que permite enchufar una tarjeta gráfica externa a velocidades de 64 Gbps — casi tan rápido como si la GPU estuviera dentro de un PC de sobremesa. Para ponerlo en contexto: un Thunderbolt 4 llega a 32 Gbps. OCuLink le dobla la velocidad, así que la GPU externa rinde al 90% o más de lo que daría montada directamente en una placa base.

El dock DEG1 de Minisforum — la cajita donde metes la GPU externa — cuesta unos 109 € y el montaje es como instalar un disco duro: enchufas un cable, atornillas la gráfica y listo.

Por qué nos importa: el camino progresivo

Aquí es donde este cacharro brilla para cualquiera que quiera montar IA en casa. La gracia es que no necesitas comprar todo de golpe.

Fase 1: solo el mini PC (~530 €). Instalas Ollama — una app gratuita que te permite correr modelos de IA en tu propio ordenador sin depender de internet — y usas la gráfica integrada Radeon 780M. Con ella puedes mover modelos como Llama 3.1 8B (un LLM — Large Language Model, básicamente un ChatGPT que corre en tu máquina — de 8.000 millones de parámetros) a unos 15-18 tokens por segundo. Un token es más o menos una palabra; 15-18 tok/s es una conversación fluida, como hablar con alguien que piensa un poco antes de responder.

Fase 2: le enchufas una GPU externa. Cuando quieras más potencia, compras el dock DEG1 y una tarjeta gráfica. Una RTX 3090 usada se encuentra por 400-500 € y tiene 24 GB de VRAM — la memoria de la gráfica donde viven los modelos de IA mientras trabajan. Con esa cantidad de VRAM puedes correr modelos de 70.000 millones de parámetros (como Llama 3.1 70B), que son los que empiezan a dar respuestas realmente buenas y útiles. Usuarios en egpu.io ya documentan este setup exacto funcionando sin problemas.

Y lo mejor: si ya tienes una GPU vieja por casa de cuando jugabas, puedes probar sin gastar nada extra en gráfica.

Qué puedes construir con esto

Las combinaciones concretas que la gente ya está montando:

- Asistente de voz local con Home Assistant — una plataforma de domótica open source que controla tu casa — usando Whisper (el sistema de transcripción de voz de OpenAI, gratuito) para entender tu voz y Piper para responder hablando. Todo local, sin que tus conversaciones salgan de tu red.

- Backend de inferencia — el proceso de pedirle a un modelo de IA que genere una respuesta — para agentes de LangChain o cualquier pipeline que necesite un LLM local al que llamar por API — una forma estandarizada de que programas distintos se hablen entre sí.

- Servidor RAG doméstico — RAG significa Retrieval-Augmented Generation, una técnica que permite al modelo de IA buscar en tus propios documentos antes de responder, como un ChatGPT que ha leído todos tus PDFs.

Cómo empezar

Lo primero: si compras el barebone (solo la caja, sin RAM ni disco), necesitarás un módulo DDR5 SO-DIMM y un SSD NVMe. Si no quieres complicarte, Minisforum lo vende ya montado por algo más.

Una vez encendido, instala Ubuntu o cualquier Linux que te guste. Después, abre la terminal de tu ordenador y escribe esto para instalar Ollama:

curl -fsSL https://ollama.com/install.sh | sh

Eso descarga e instala Ollama automáticamente. Cuando termine, lanza tu primer modelo con este comando:

ollama run llama3.1:8b

Verás cómo descarga el modelo (~4.7 GB) y en menos de un minuto tienes un chat de IA corriendo entero en tu máquina. Sin cuenta, sin suscripción, sin que nada salga de tu red.

Si más adelante conectas una GPU NVIDIA por OCuLink, necesitarás instalar los drivers — los programas que permiten a Linux hablar con la gráfica. La guía oficial de Ollama para GPU NVIDIA lo cubre paso a paso.

Lo que no te van a contar

La gráfica integrada Radeon 780M funciona con Ollama, pero el soporte ROCm — el framework de AMD para computación en GPU — en Linux todavía da algún dolor de cabeza con ciertos modelos. A veces toca ajustar variables de entorno o usar versiones específicas. Con GPU NVIDIA vía OCuLink todo va más rodado, pero estás añadiendo una caja extra, cables y una fuente de alimentación para la gráfica: tu escritorio minimalista deja de serlo. Además, el barebone a 530 € no incluye RAM ni disco: el coste final del PC funcional ronda los 600-650 €, y si le sumas dock más gráfica usada estás ya en los 1.100-1.200 €. Sigue siendo más barato que un PC gaming equivalente, pero no es “530 € y listo”.

Veredicto

Si quieres un servidor de IA doméstico que empiece pequeño y crezca contigo, esto es lo mejor que puedes comprar ahora mismo. Para quien solo quiera probar modelos pequeños sin escalar nunca, un mini PC sin OCuLink saldrá más barato. Pero si sabes que vas a querer más — y si estás leyendo esto, probablemente vas a querer más — el UM890 Pro es la puerta de entrada que no te obliga a tirar nada cuando subas de nivel.